Scrapy 框架运作流程、配置安装及入门案例

Scrapy 框架运作流程、配置安装及入门案例

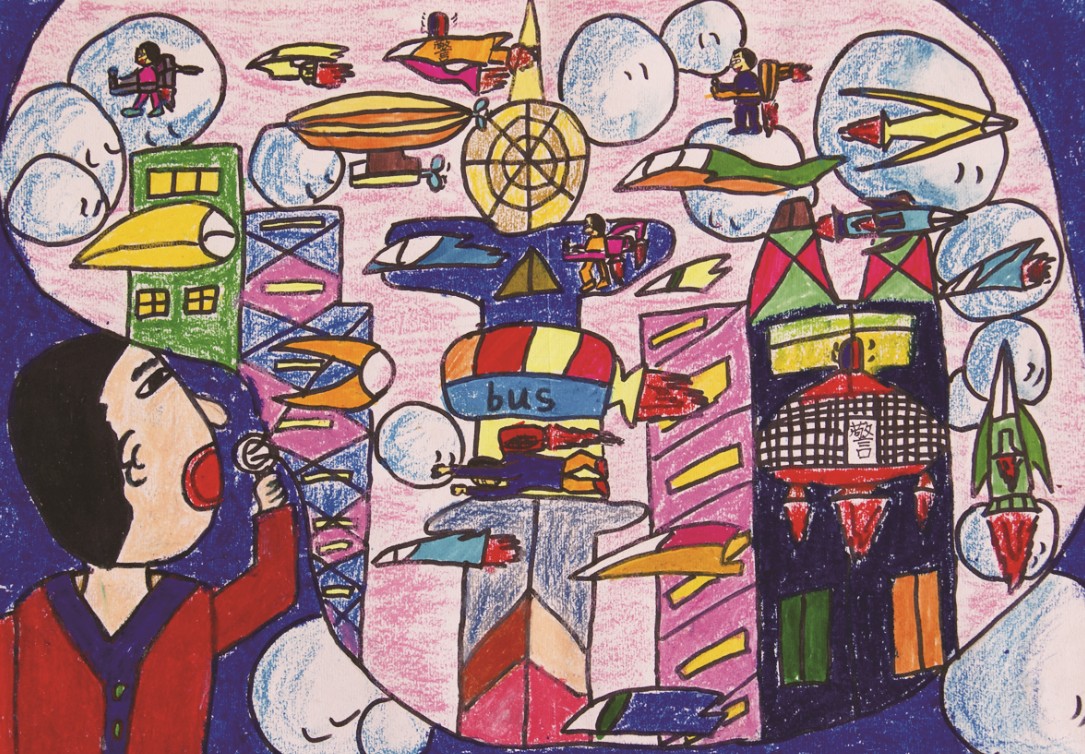

一、 框架架构图(绿线是数据流向):

的运作流程

代码写好,程序开始运行...

引擎:Hi!, 你要处理哪一个网站?:老大要我处理。引擎:你把第一个需要处理的URL给我吧。:给你,第一个URL是。引擎:Hi!调度器,我这有请求你帮我排序入队一下。调度器:好的,正在处理你等一下。引擎:Hi!调度器,把你处理好的请求给我。调度器:给你,这是我处理好的引擎:Hi!下载器xpath 入门,你按照老大的下载中间件的设置帮我下载一下这个请求下载器:好的!给你,这是下载好的东西。(如果失败:sorryxpath 入门,这个下载失败了。然后引擎告诉调度器,这个下载失败了,你记录一下,我们待会儿再下载)引擎:Hi!,这是下载好的东西,并且已经按照老大的下载中间件处理过了,你自己处理一下(注意!这儿默认是交给def parse()这个函数处理的):(处理完毕数据之后对于需要跟进的URL),Hi!引擎,我这里有两个结果,这个是我需要跟进的URL,还有这个是我获取到的Item数据。引擎:Hi !管道 我这儿有个item你帮我处理一下!调度器!这是需要跟进URL你帮我处理下。然后从第四步开始循环,直到获取完老大需要全部信息。管道``调度器:好的,现在就做!

注意!只有当调度器中不存在任何了,整个程序才会停止,(也就是说,对于下载失败的URL,也会重新下载。)

制作 爬虫 一共需要4步:

二、配置安装的安装介绍

框架官方网址:

中文维护站点:

安装方式 需要9.10或以上版本安装方式

安装后xpath 入门,只要在命令终端输入 ,提示类似以下结果,代表已经安装成功

具体安装流程参考:

intro---notes 里面有各个平台的安装方法

三、入门案例1. 新建项目( )

scrapy startproject mySpider下面来简单介绍一下各个主要文件的作用:

.cfg :项目的配置文件

/ :项目的模块,将会从这里引用代码

/items.py :项目的目标文件

/.py :项目的管道文件

/.py :项目的设置文件

// :存储爬虫代码目录

2. 明确目标(/items.py)

我们打算抓取:

网站里的所有讲师的姓名、职称和个人信息。

打开目录下的items. 定义结构化数据字段,用来保存爬取到的数据Scrapy 框架运作流程、配置安装及入门案例,有点像中的dict,但是提供了一些额外的保护减少错误。可以通过创建一个 .Item 类, 并且定义类型为 .Field的类属性来定义一个Item(可以理解成类似于ORM的映射关系)。接下来,创建一个 类,和构建item模型(model)。

import scrapy

class ItcastItem(scrapy.Item):

name = scrapy.Field()

level = scrapy.Field()

info = scrapy.Field()3. 制作爬虫 (/.py)

爬虫功能要分两步:

(1)爬数据

scrapy genspider itcast "itcast.cn"import scrapy

class ItcastSpider(scrapy.Spider):

name = "itcast"

allowed_domains = ["itcast.cn"]

start_urls = (

'http://www.itcast.cn/',

)

def parse(self, response):

pass其实也可以由我们自行创建.py并编写上面的代码Scrapy 框架运作流程、配置安装及入门案例,只不过使用命令可以免去编写固定代码的麻烦

要建立一个, 你必须用.类创建一个子类,并确定了三个强制的属性 和 一个方法。

负责解析返回的网页数据(.body),提取结构化数据(生成item)生成需要下一页的URL请求。

将的值修改为需要爬取的第一个url

start_urls = ("http://www.itcast.cn/channel/teacher.shtml",)修改parse()方法

def parse(self, response):

with open("teacher.html", "w") as f:

f.write(response.text)然后运行一下看看,在目录下执行:

scrapy crawl itcast是的,就是 ,看上面代码,它是 类的 name 属性,也就是使用 命令的爬虫名。

一个爬虫项目里,可以存在多个爬虫。各个爬虫在执行时,就是按照 name 属性来区分。

运行之后,如果打印的日志出现 INFO: (),代表执行完成。 之后当前文件夹中就出现了一个 .html 文件,里面就是我们刚刚要爬取的网页的全部源代码信息。

# 注意,Python2.x默认编码环境是ASCII,当和取回的数据编码格式不一致时,可能会造成乱码;

# 我们可以指定保存内容的编码格式,一般情况下,我们可以在代码最上方添加:

import sys

reload(sys)

sys.setdefaultencoding("utf-8")

# 这三行代码是Python2.x里解决中文编码的万能钥匙,经过这么多年的吐槽后Python3学乖了,默认编码是Unicode了...(祝大家早日拥抱Python3)(2)取数据

xxx

xxxxx

xxxxxxxx

是不是一目了然?直接上XPath开始提取数据吧。

from mySpider.items import ItcastItem

from mySpider.items import ItcastItem

def parse(self, response):

#open("teacher.html","wb").write(response.body).close()

# 存放老师信息的集合

items = []

for each in response.xpath("//div[@class='li_txt']"):

# 将我们得到的数据封装到一个 `ItcastItem` 对象

item = ItcastItem()

#extract()方法返回的都是unicode字符串

name = each.xpath("h3/text()").extract()

title = each.xpath("h4/text()").extract()

info = each.xpath("p/text()").extract()

#xpath返回的是包含一个元素的列表

item['name'] = name[0]

item['title'] = title[0]

item['info'] = info[0]

items.append(item)

# 直接返回最后数据

return items

保存数据保存信息的最简单的方法主要有四种,-o 输出指定格式的文件,,命令如下:

# json格式,默认为Unicode编码

scrapy crawl itcast -o teachers.json

# json lines格式,默认为Unicode编码

scrapy crawl itcast -o teachers.jsonl

# csv 逗号表达式,可用Excel打开

scrapy crawl itcast -o teachers.csv

# xml格式

scrapy crawl itcast -o teachers.xml

思考如果将代码改成下面形式,结果完全一样。请思考 yield 在这里的作用:

from mySpider.items import ItcastItem

def parse(self, response):

#open("teacher.html","wb").write(response.body).close()

# 存放老师信息的集合

#items = []

for each in response.xpath("//div[@class='li_txt']"):

# 将我们得到的数据封装到一个 `ItcastItem` 对象

item = ItcastItem()

#extract()方法返回的都是unicode字符串

name = each.xpath("h3/text()").extract()

title = each.xpath("h4/text()").extract()

info = each.xpath("p/text()").extract()

#xpath返回的是包含一个元素的列表

item['name'] = name[0]

item['title'] = title[0]

item['info'] = info[0]

#items.append(item)

#将获取的数据交给pipelines

yield item

# 返回数据,不经过pipeline

#return items

加入微信交流群:************ ,请猛戳这里→点击入群- 随机文章

- 热门文章

- 热评文章